· Eduardo Vieira · Vision AI · 2 min de lectura

Edge AI en la Industria: YOLOv11, Hailo-8 y el Fin de los Defectos

La visión artificial ya no es solo para laboratorios. Aprende a implementar detección de defectos en tiempo real (100+ FPS) integrada con tu PLC.

Detectar un defecto en una línea de producción que se mueve a 3 metros por segundo requiere más que una simple cámara. Requiere Visión de Borde (Edge AI) de bajísima latencia.

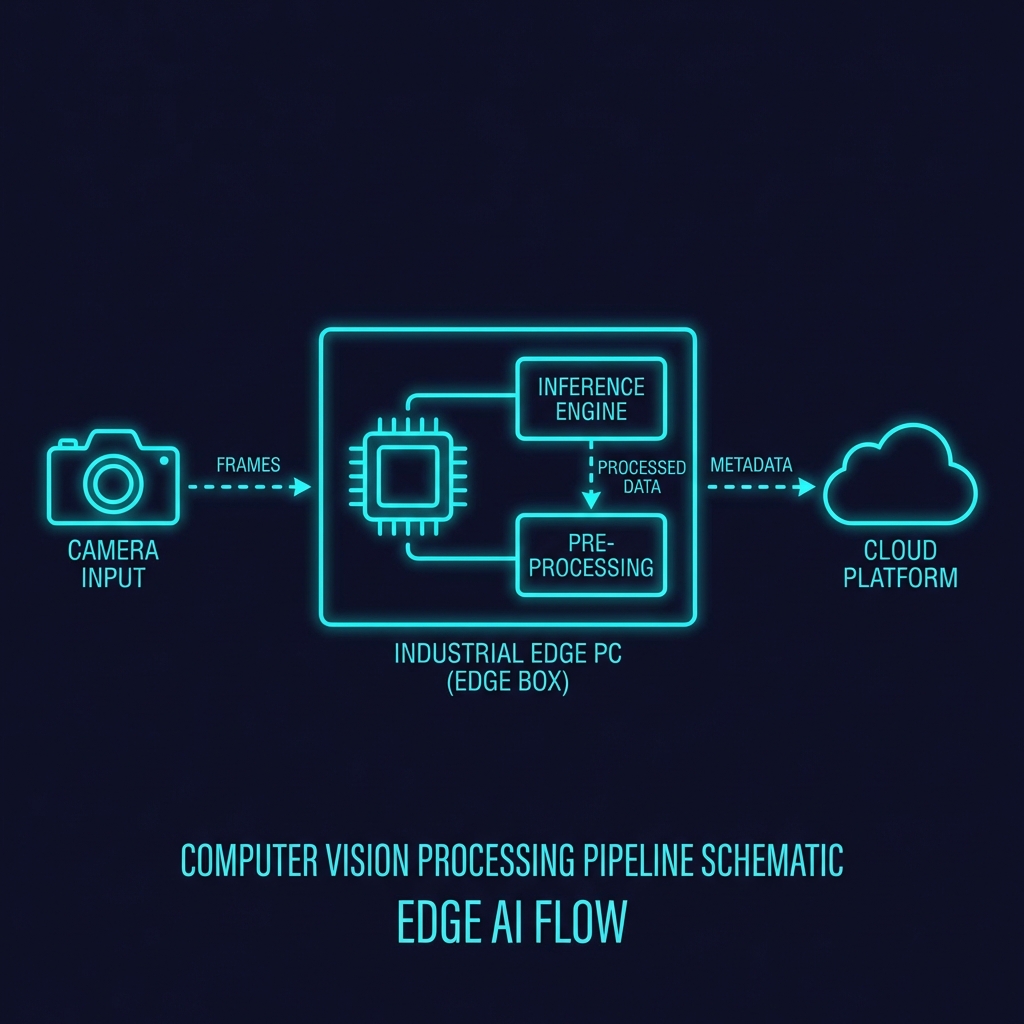

En este “Capstone post”, unimos todo lo aprendido: protocolos industriales, hardware endurecido y el estado del arte en inteligencia artificial para crear un sistema de inspección de calidad automatizado.

1. El Stack Tecnológico: YOLOv11 + Hailo-8

Para alcanzar más de 100 FPS en una Raspberry Pi 5, no puedes usar la CPU. Necesitas una NPU (Neural Processing Unit).

- YOLOv11: El modelo más reciente de Ultralytics, optimizado para detectar objetos pequeños (como grietas o manchas) con altísima precisión.

- Hailo-8: Un acelerador de 26 TOPS que procesa el modelo en milisegundos sin calentar la CPU.

2. Cerrando el Lazo: De la Inferencia a la Acción

Un modelo de IA que solo muestra un recuadro rojo en una pantalla es inútil en una fábrica. El valor real está en detener la máquina o expulsar la pieza defectuosa.

El Flujo de Trabajo

- Captura: Cámara HQ capturando a 120 FPS.

- Inferencia: El Hailo-8 procesa el frame y confirma un defecto con >90% de confianza.

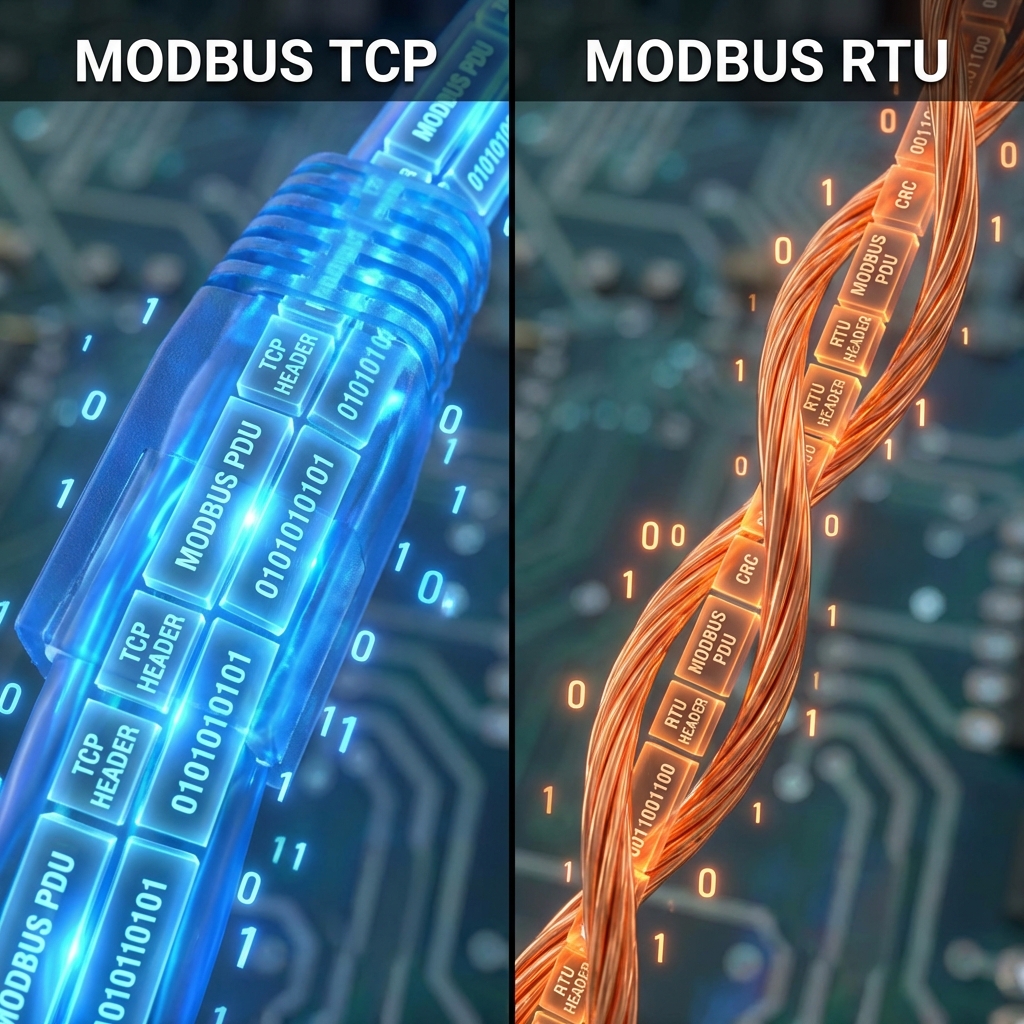

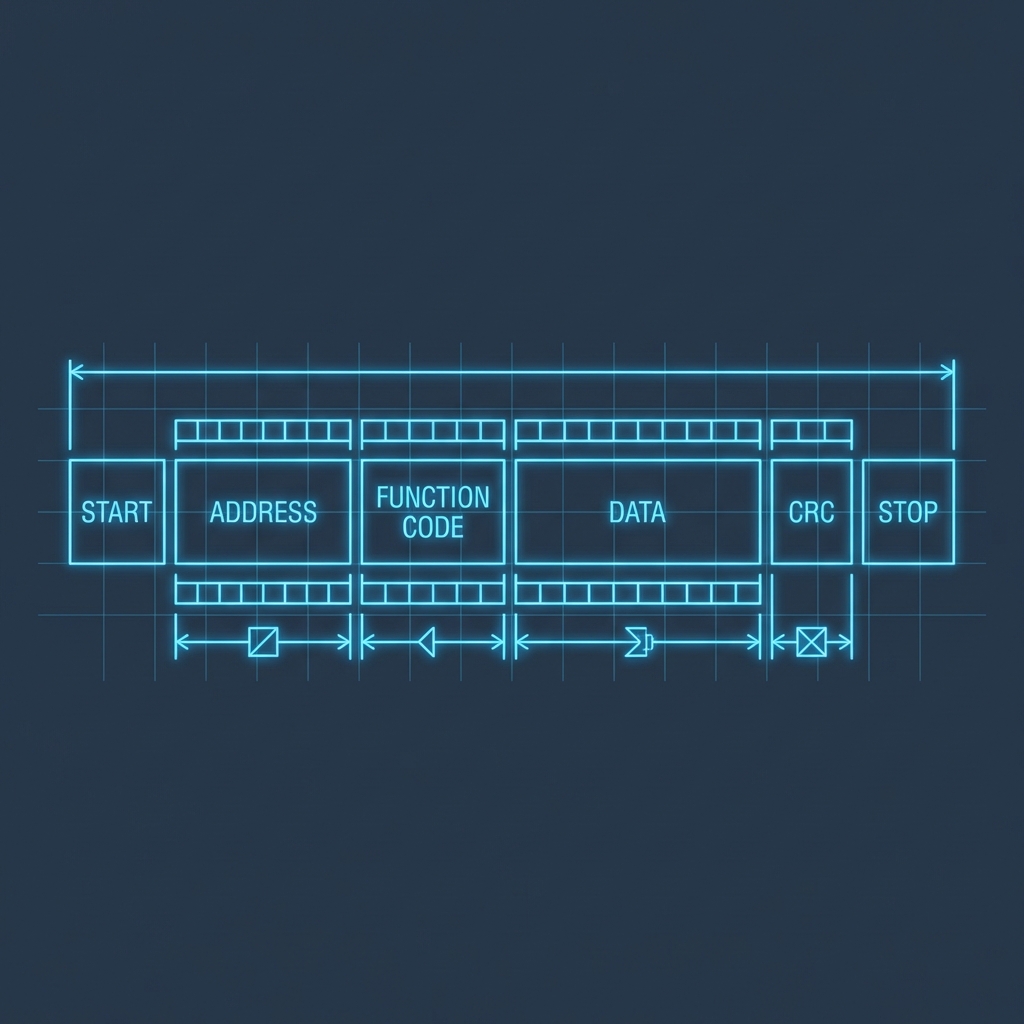

- Acción: El script de Python envía un comando Modbus TCP al PLC para activar un soplador neumático en el registro 100.

👉 Código Completo: edge-ai-inspection

Ejemplo de Lógica Integrada

if results.defect_detected:

# Escribir en el PLC Coil 100 (Rechazo)

plc.write_coil(100, True)3. Despliegue con Docker

En planta, no instalas librerías a mano. Usas contenedores. Esto garantiza que la versión de los drivers de Hailo y de OpenCV sea idéntica en el laboratorio y en la línea de montaje.

4. Latencia Crítica: El Jitter es el Enemigo

Si el sistema tarda 500ms en procesar, para cuando el PLC recibe la orden, la pieza ya pasó de largo.

- Latencia Objetivo: <20ms desde que la luz toca el sensor hasta que el aire sale por la boquilla.

- Optimización: Usa GStreamer para el pipeline de video, evitando el overhead de la cola de frames de OpenCV.

Conclusión

La Inteligencia Artificial es el nuevo sensor industrial. Al integrar YOLOv11 con protocolos estándar como Modbus, convertimos una cámara en un inspector que nunca se cansa y nunca parpadea.

Fuentes y Referencias:

- Ultralytics: YOLOv11 Documentation

- Hailo: Hailo-8 Edge AI Processor Overview

- IEEE: Real-time Vision Systems in Industrial Automation